사이트 진단이 제대로 실행되지 않나요?

웹사이트의 구성 및 구조에 따라 사이트 진단 크롤러가 페이지를 차단할 수 있는 이유는 여러 가지가 있습니다. 여기에는 다음이 포함됩니다.

- robots.txt 차단 크롤러

- 사이트의 특정 영역을 제외한 크롤링 범위

- 공유 호스팅으로 인해 웹사이트가 바로 접근 가능한 온라인 상태가 아님

- 랜딩 페이지 크기가 2Mb를 초과함

- 게이트웨이/로그인을 거쳐야 페이지에 접근 가능

- noindex 태그로 인해 크롤러가 차단됨

- DNS에서 도메인을 확인할 수 없음—설정에서 입력한 도메인이 오프라인 상태임

- 웹사이트 콘텐츠가 JavaScript로 구축됨—사이트 진단 도구가 JS 코드를 렌더링할 수 있음에도 일부 문제의 원인이 될 수 있음

문제 해결 단계

지원팀에 도움을 요청하기 전에 문제 해결 단계에 따라 직접 조정할 수 있는 부분이 있는지 확인하세요.

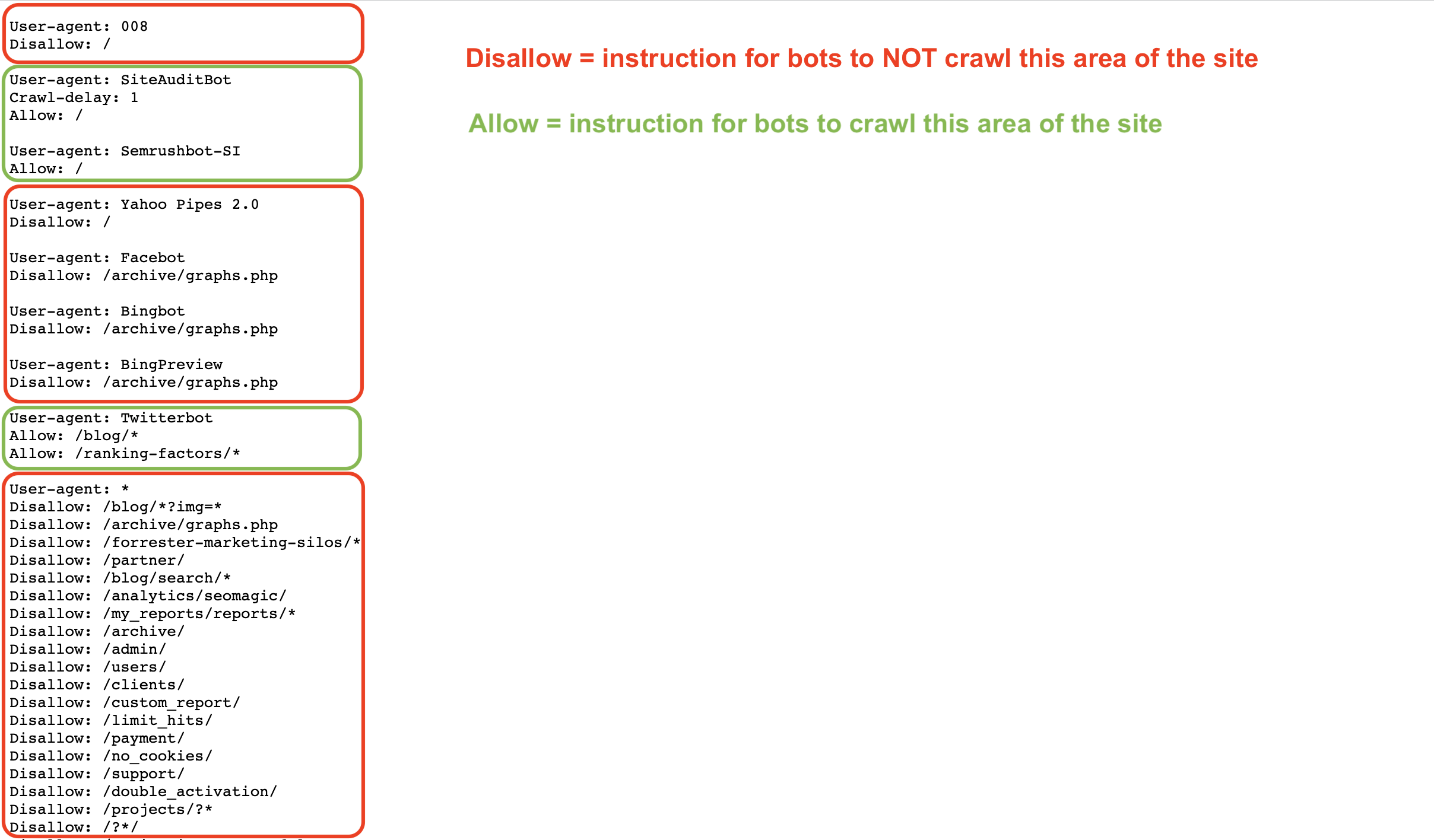

robots.txt 파일 은 봇에게 웹사이트 페이지를 크롤링하는 방법(또는 크롤링하지 않는 방법)에 대한 지침을 제공합니다. Allow, Disallow, Crawl Delay 같은 명령을 사용하여 Googlebot이나 Semrushbot 같은 봇이 사이트 전체 또는 사이트의 특정 영역을 크롤링하는 것을 허용하거나 금지할 수 있습니다.

robots.txt가 봇이 사이트를 크롤링하는 것을 허용하지 않는 경우, 사이트 진단 도구가 사이트를 확인할 수 없습니다.

내 웹사이트에 크롤러가 접근하는 것을 방해하는 disallow 명령이 있는지 robots.txt를 검사해 보세요.

Semrush 사이트 진단 봇(SiteAuditBot)이 사이트를 크롤링할 수 있도록 허용하려면 robots.txt 파일에 다음을 추가하세요.

User-agent: SiteAuditBot

Disallow:

("Disallow:" 뒤에 공백을 남겨주세요.)

robots.txt 파일은 다음과 같은 모습으로 표시됩니다.

사용자 에이전트(크롤러)에 따라 파일에서 지정한 명령이 다를 수 있으니 유의하세요.

이 파일들은 공개되어 있으며 검색되기 위해서는 사이트의 최상위에 호스팅되어야 합니다. 웹사이트의 robots.txt 파일을 찾으려면 브라우저에서 사이트의 루트 도메인 뒤에 /robots.txt를 입력하세요. 예를 들어 Semrush.com의 robots.txt 파일은 https://sr02.devserver.cv/robots.txt에서 찾을 수 있습니다.

robots.txt 파일에서 볼 수 있는 몇 가지 용어는 다음과 같습니다.

- User-Agent = 사용자가 지침을 제공하는 웹 크롤러입니다.

- 예: SiteAuditBot, Googlebot

- Allow = 상위 페이지 또는 폴더의 크롤링은 금지되어 있어도 사이트의 특정 페이지 또는 영역은 크롤링할 수 있음을 봇에게 알려주는 명령입니다(Googlebot에만 해당).

- Disallow = 봇에게 사이트의 특정 URL 또는 하위 폴더를 크롤링하지 않도록 지시하는 명령입니다.

- 예: Disallow: /admin/

- Crawl Delay = 봇이 다른 페이지를 로드하고 크롤링하기 전에 몇 초 동안 대기해야 하는지 지시하는 명령입니다.

- Sitemap = 특정 URL에 대한 sitemap.xml 파일의 위치를 나타냅니다.

- / = 봇이 사이트 전체를 크롤링하지 않도록 하려면 disallow 명령 뒤에 "/" 기호를 사용합니다.

- * = URL에 있는 모든 문자열을 나타내는 와일드카드 기호로, 사이트의 특정 영역이나 모든 사용자 에이전트를 나타내는 데 사용됩니다.

- 예: Disallow: /blog/*는 사이트의 blog 하위 폴더에 있는 모든 URL을 나타냅니다.

- 예: User-agent: *은 모든 봇에 대한 지침을 나타냅니다.

Robots.txt 사양에 대한 자세한 내용은 Google 또는 Semrush 블로그에서 확인하세요.

웹사이트의 메인 페이지에 다음 코드가 표시되어 있다면 Semrush가 해당 웹사이트의 링크를 인덱싱하거나 팔로우할 수 없으며, Semrsh의 액세스가 차단된다는 의미입니다.

또는 "noindex", "nofollow", "none" 중 하나를 포함하는 페이지에서 크롤링 오류가 발생합니다.

Semrush 봇이 해당 페이지를 크롤링할 수 있도록 하려면 페이지 코드에서 "noindex" 태그를 제거하세요. noindex 태그에 대한 자세한 내용은 Google 도움말을 참조하세요.

봇을 허용하려면 웹마스터 또는 호스팅 제공업체에 문의하여 SiteAuditBot을 허용하도록 요청하세요.

봇의 IP 주소는 85.208.98.128/25 (사이트 진단 전용 서브넷)입니다.

이 봇은 표준 80 HTTP 및 443 HTTPS 포트를 사용하여 연결합니다.

사이트를 관리하기 위해 플러그인(예: WordPress)이나 CDN(콘텐츠 전송 네트워크)을 사용하는 경우 해당 플러그인이나 CDN 내에서도 봇 IP를 허용 목록에 추가해야 합니다.

WordPress에서 봇을 허용하려면 WordPress 지원팀에 문의하세요.

Semrush 크롤러를 차단하는 일반적인 CDN은 다음과 같습니다.

- Cloudflare - 여기에서 봇을 허용 목록에 추가하는 방법을 알아보세요.

- Imperva - 여기에서 봇을 허용 목록에 추가하는 방법을 알아보세요.

- ModSecurity - 여기에서 봇을 허용 목록에 추가하는 방법을 알아보세요.

- Sucuri - 여기에서 봇을 허용 목록에 추가하는 방법을 알아보세요.

참고: 공유 호스팅을 사용하는 경우 호스팅 제공업체가 봇을 허용 목록에 추가하거나 Robots.txt 파일을 수정하는 것을 허용하지 않을 수 있습니다.

호스팅 제공업체

웹에서 가장 인기 있는 호스팅 제공업체 목록과 각 제공업체에서 봇을 허용 목록에 추가하는 방법, 지원팀에 문의하는 방법을 살펴보세요.

- Siteground - 허용 목록 추가 지침

- 1&1 IONOS - 허용 목록 추가 지침

- Bluehost* - 허용 목록 추가 지침

- Hostgator* - 허용 목록 추가 지침

- Hostinger - 허용 목록 추가 지침

- GoDaddy - 허용 목록 추가 지침

- GreenGeeks - 허용 목록 추가 지침

- Big Commerce - 지원팀에 문의 필요

- Liquid Web - 지원팀에 문의 필요

- iPage - 지원팀에 문의 필요

- InMotion - 지원팀에 문의 필요

- Glowhost - 지원팀에 문의 필요

- Hosting - 지원팀에 문의 필요

- DreamHost - 지원팀에 문의 필요

* 참고: VPS 또는 전용 호스팅을 사용하는 웹사이트의 경우 HostGator 및 Bluehost 에서 이 지침이 적용됩니다.

랜딩 페이지 크기 또는 JavaScript/CSS 파일의 총 크기가 2Mb를 초과하면 도구의 기술적 제약으로 인해 크롤러가 이를 처리할 수 없습니다.

크기가 증가하는 원인과 이 문제를 해결하는 방법에 대해 자세히 알아보려면 Semrush 블로그에서 이 게시물을 참조하세요.

현재 크롤링 예산이 얼마나 사용되었는지 확인하려면 프로필 - 구독 정보 로 이동하여 'SEO 툴킷' 아래의 '크롤링할 페이지'를 확인하세요.

구독 등급에 따라 한 달에 크롤링할 수 있는 페이지 수(월간 크롤링 예산)가 정해져 있습니다. 구독에서 허용되는 페이지 수를 초과할 경우 추가 한도를 구매하거나 한도가 새로고침되는 다음 달까지 기다려야 합니다.

또한 설정 중에 '동시에 실행할 수 있는 캠페인의 한도에 도달했습니다' 라는 오류 메시지가 표시되는 경우, 해당 구독 등급에서 동시에 실행할 수 있는 사이트 진단 건수의 최대 한도에 도달했다는 의미입니다.

구독 등급마다 한도가 다릅니다.

- 무료 계정: 한 번에 사이트 진단 1건

- Pro SEO 툴킷: 동시 사이트 진단 최대 2건

- Guru SEO 툴킷: 동시 사이트 진단 최대 2건

- Business SEO 툴킷: 동시 사이트 진단 최대 5건

DNS에서 도메인을 확인할 수 없는 경우, 구성 중에 입력한 도메인이 오프라인 상태일 가능성이 높습니다. 일반적으로 사이트의 루트 도메인 버전이 존재하지 않고 대신 사이트의 WWW 버전(www.example.com)을 입력해야 한다는 사실을 인지하지 못한 채 루트 도메인(example.com)을 입력할 때 이 문제가 발생합니다.

이 문제를 방지하기 위해 웹사이트 소유자는 보안 상태가 아닌 'example.com'에서 서버에 존재하는 보안 상태의 'www.example.com'으로 리디렉션을 추가할 수 있습니다. 이 문제는 루트 도메인은 보안 상태이지만 WWW 버전은 보안 상태가 아닌 반대의 경우에도 발생할 수 있습니다. 이 경우에는 WWW 버전을 루트 도메인으로 리디렉션하면 됩니다.

홈페이지에서 사이트의 다른 페이지로 가는 링크가 JavaScript 요소에 숨겨져 있는 경우, 크롤러가 이러한 링크를 읽고 해당 페이지를 크롤링할 수 있도록 JavaScript 렌더링을 활성화해야 합니다. 이 기능은 SEO 툴킷의 Guru 및 Business 구독 등급에서 사용할 수 있습니다.

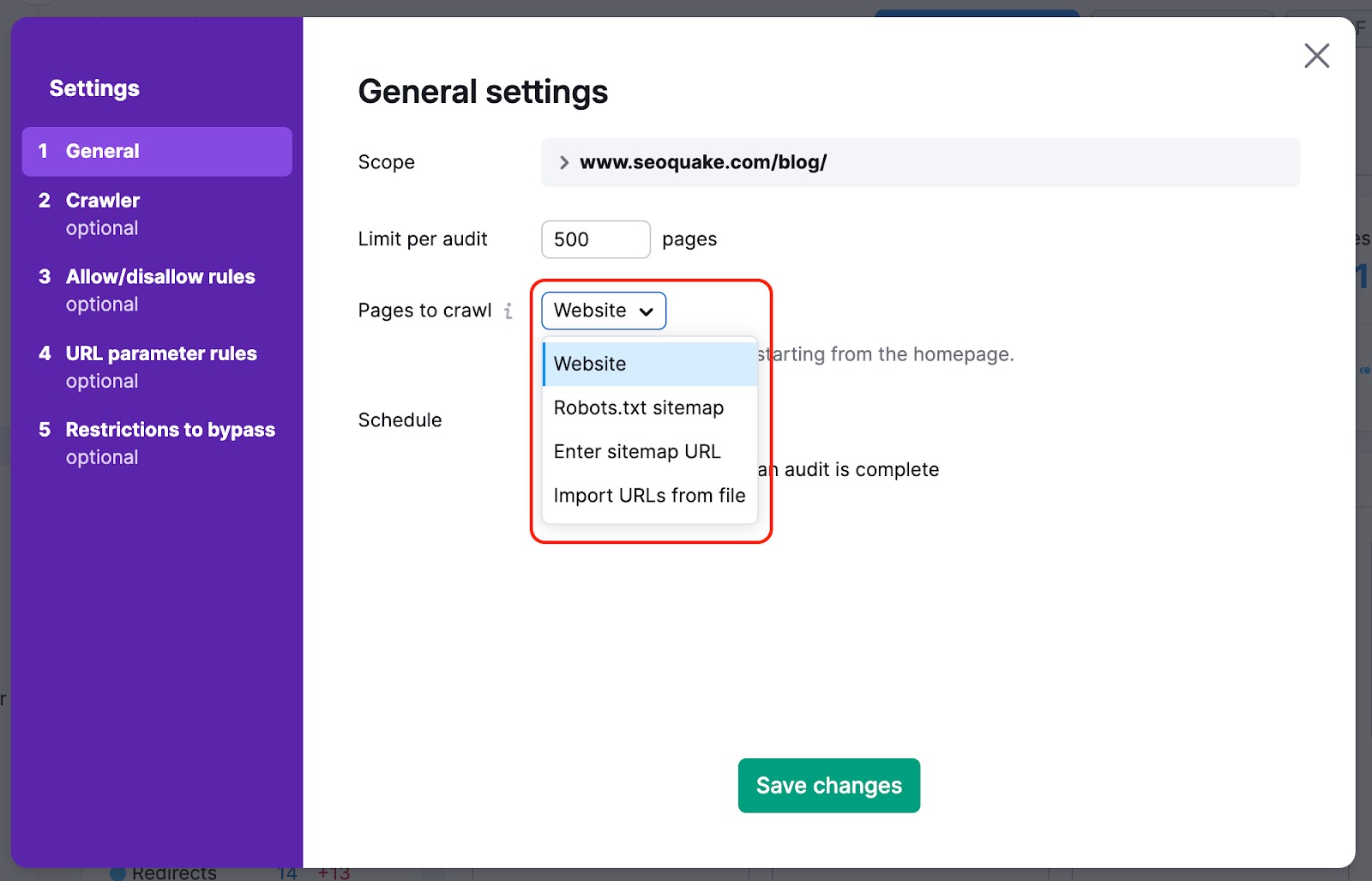

크롤링 시 웹사이트의 가장 중요한 페이지를 놓치지 않으려면 크롤링 소스를 웹사이트에서 사이트맵으로 변경하면 됩니다. 이렇게 하면 크롤러가 진단 중에 웹사이트에서 찾기 어려운 페이지를 놓치지 않을 수 있습니다.

또한 일부 JS 요소가 있는 페이지의 HTML을 크롤링하고 성능 검사를 통해 JS 및 CSS 파일의 매개변수를 검토할 수 있습니다.

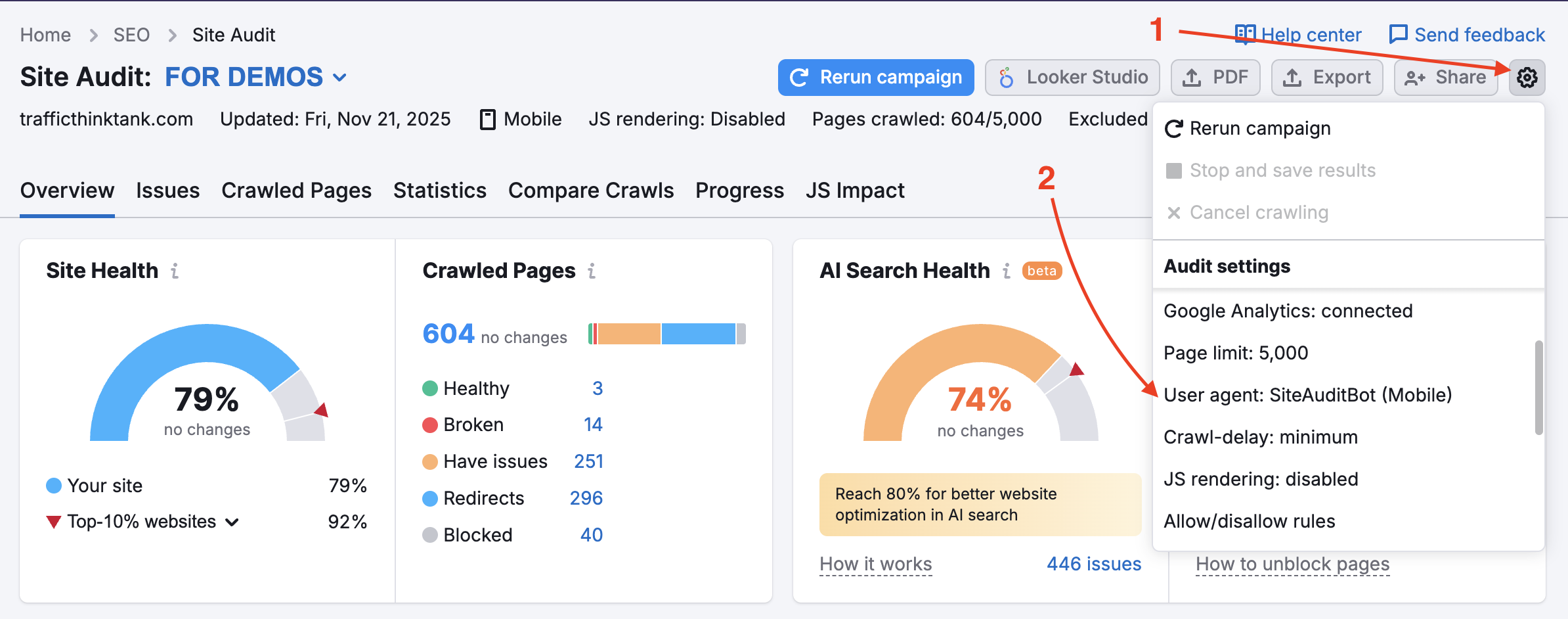

내 웹사이트의 robots.txt 파일에서 SemrushBot이 차단되고 있을 수 있습니다. 사용자 에이전트를 SemrushBot에서 GoogleBot으로 변경할 수 있으며, 내 웹사이트는 Google 사용자 에이전트의 크롤링을 허용하고 있을 가능성이 높습니다. 이 변경 사항을 적용하려면 프로젝트에서 설정 아이콘을 찾고 사용자 에이전트를 선택하세요.

이 옵션을 켜면 크롤러가 robots.txt의 disallow 규칙을 무시하므로, 일반적으로 차단되는 페이지와 내부 리소스도 크롤링됩니다. 이렇게 하려면 사이트 소유권을 확인해야 한다는 점에 유의하세요.

이 옵션은 현재 유지 관리 중인 사이트에 유용합니다. 사이트 소유자가 robots.txt 파일을 수정하지 않으려는 경우에도 유용합니다.

비밀번호로 보호된 웹사이트의 비공개 영역을 진단하려면 설정 아이콘 아래의 '내 자격 증명으로 크롤링하기' 옵션에 자격 증명을 입력하세요.

아직 개발 중이거나 비밀번호로 완전히 보호되는 비공개 사이트에 이 방법을 적극 권장합니다.

Shopify와 같은 일부 웹사이트와 호스팅 플랫폼은 알 수 없는 봇을 보안 또는 성능상의 이유로 자동 차단할 수 있습니다. 이러한 플랫폼에서 진단에 실패하는 경우 Web Bot Auth 서명을 추가하면 Semrush 크롤러가 자체 인증을 거쳐 웹사이트에 액세스할 권한이 있음을 증명할 수 있습니다.

초기 설정 시 서명을 제공하지 않아 사이트가 차단된 경우, Semrush가 해당 제한을 감지하고 도구 인터페이스에서 바로 문제를 해결할 수 있도록 안내합니다.

“이전 진단 이후 크롤러 설정이 변경되었습니다. 이는 현재 진단 결과와 감지된 문제 수에 영향을 미칠 수 있습니다.”

설정을 업데이트하고 진단을 다시 실행하면 사이트 진단에 이 알림이 표시됩니다. 이는 문제를 나타내는 지표가 아니라 크롤링 결과가 예기치 않게 변경된 경우 그 이유가 될 수 있음을 나타냅니다.

Semrush 블로그에서 일반적인 SEO 문제 및 해결 방법 게시물을 확인하세요.